2026年4月10日:一文读懂AI助手Neon——从核心概念到原理与面试实战

引言:AI助手,你身边的新一代智能伙伴

你是否也遇到过这种情况:想用AI查个资料,却要在ChatGPT、Claude、DeepSeek等多个助手之间来回切换;想完成一个简单的数据库操作,却要记住一长串SQL命令;想让AI帮你订个机票,它却只能给你结果链接而非直接完成预订?这些看似琐碎的体验问题,正是AI助手领域正在集中攻克的痛点。2026年,AI助手已成为各大科技公司角逐的核心战场——国内DeepSeek和豆包占据通用市场主流份额-,全球专注于AI Agent研发的公司已超过一万家-。在这样的背景下,一个名为Neon的AI助手正以差异化的技术路线进入开发者视野,成为连接大语言模型与实际生产力工具的关键桥梁。本文将从痛点出发,带你系统理解Neon的核心概念、技术原理与实战应用,并提供高频面试考点,无论你是技术入门者还是在职开发者,都能从中获得体系化的知识链路。

一、痛点切入:为什么我们需要AI助手Neon?

先来看一个真实的数据库操作场景。传统方式下,如果你想创建一个PostgreSQL数据库并建立用户表,需要在终端或数据库客户端中手动编写SQL:

-- 传统方式:手工编写SQL语句 CREATE DATABASE user_db; \c user_db; CREATE TABLE users ( id SERIAL PRIMARY KEY, name VARCHAR(100) NOT NULL, email VARCHAR(100) UNIQUE NOT NULL, created_at TIMESTAMP DEFAULT CURRENT_TIMESTAMP );

这种方法看似简单,却存在几个显而易见的问题:

语法负担重:需要记住并准确拼写各种SQL关键字,遗漏一个分号或写错一个表名都会导致执行失败。

工具切换频繁:编写代码、查询数据库、管理分支,需要在IDE、终端、数据库管理工具之间来回切换,打断开发思路。

协作成本高:团队成员之间分享数据库结构和操作流程,往往依赖文档或口头沟通,缺乏标准化。

错误风险大:一条优化不当的SQL语句遗漏了关键索引,可能导致核心表被全表扫描,在交易时段引发大量指令受阻-。技术人员需要在不同数据库的SQL方言、管理协议和工具界面间频繁切换,认知负担沉重-。

正是这些长期困扰开发者的痛点,催生了AI助手与数据库管理深度融合的需求。AI助手Neon的出现,正是为了将复杂的数据库操作抽象为简单的自然语言交互,让开发者不再需要成为SQL专家就能高效管理数据库-2。

二、核心概念讲解:AI助手Neon与Agent

什么是AI Agent?

AI Agent(AI智能体) 是指一种能够自主感知环境、理解用户意图、进行逻辑推理与任务规划、调用工具完成目标,并具备自我迭代能力的AI系统-。与传统大模型(LLM)不同,传统模型更像是“被动执行指令”的工具,只能完成单一、简单的任务;而Agent则具备自主决策和任务拆解能力,能够“主动帮你完成事情”-。

用生活化的类比来理解:传统大模型就像一个知识渊博但需要你一步步告诉它怎么做的“顾问”——你问什么它答什么,但不会主动帮你执行。而Agent更像一个“全能助理”——你告诉它“帮我订一张明天去北京的机票”,它会自己思考需要查航班、比价格、选座位、完成支付,然后把结果反馈给你。

什么是AI助手Neon?

在AI助手领域,“Neon”实际上指向两个核心方向,容易混淆,需要区分清楚:

1. Opera Neon——AI智能体浏览器

Opera公司在2025年推出的AI原生浏览器,包含三个核心功能:Chat(聊天)、Do(执行)和Make(创作)。聊天功能将对话式AI助手直接嵌入浏览器,用户无需切换标签页即可提问或获取上下文信息;“执行”智能体可以自动化填写表单、旅行预订信息、完成在线购物等操作;“创作”功能则让用户生成网站、报告、代码片段或视觉资产-13。Opera Neon并非在传统浏览器上加AI功能,而是从底层设计上重构了浏览器的定位,将其打造为“智能体式”浏览器-11。

2. Neon AI——对话型AI智能体平台

这是一个面向企业和个人的AI助手定制平台,主打完全可控的私有化部署。与传统公有云部署的AI平台不同,Neon AI的核心优势在于:用户拥有AI模型、数据、知识库及应用的完整控制权,支持深度定制不同业务场景的AI助手,解决了传统AI的中立性和数据隐私痛点-4-。它提供社区开源版(免费)、企业定制版和白标私有部署三种方案,适合从个人开发者到金融机构的不同需求层次-4。

3. Neon MCP Server——AI与数据库的桥梁

这是目前开发者社群中讨论度最高的“Neon”相关项目。MCP(Model Context Protocol,模型上下文协议) 是由Anthropic公司于2024年底提出的开放协议,旨在为大语言模型(LLM)与外部数据源、工具之间建立标准化的交互方式-。Neon MCP Server正是基于这一协议构建的服务,它让支持MCP的AI助手能够通过自然语言与Neon数据库进行交互——你可以通过对话的方式,让AI助手帮你完成创建项目、管理分支、执行SQL查询等数据库操作,无需记忆复杂的SQL命令-2。

概念关系梳理

三者之间的关系可以用一句话概括:Opera Neon是面向终端用户的AI浏览器产品,Neon AI是面向企业的AI智能体定制平台,而Neon MCP Server则是连接AI与数据库的底层基础设施协议实现。

| 产品 | 定位 | 目标用户 | 核心价值 |

|---|---|---|---|

| Opera Neon | AI原生浏览器 | 普通用户 | 将浏览器从“被动展示”变为“主动执行” |

| Neon AI | 私有化AI平台 | 企业、开发者 | 让用户拥有并掌控自己的AI助手 |

| Neon MCP Server | AI-数据库连接协议 | 开发者 | 用自然语言管理数据库 |

三、代码示例:用自然语言管理数据库

Neon MCP Server的使用体验非常直观。假设你已经在Claude Desktop或其他支持MCP的客户端中配置好了Neon MCP Server,你可以直接输入自然语言命令来操作数据库:

示例对话1:创建数据库

用户:给我创建一个用户数据库,包含id、姓名、邮箱和注册时间字段 好的,我来帮你创建这个数据库... [自动执行] 创建PostgreSQL项目 [自动执行] 建立用户表,包含字段:id (主键), name, email, created_at [返回] 数据库创建成功,连接字符串已生成

示例对话2:执行查询

用户:帮我查出最近7天内注册的所有用户 正在执行查询... [自动生成SQL] SELECT FROM users WHERE created_at > NOW() - INTERVAL '7 days' [返回] 共找到12条记录,以下是详细信息...

在技术实现层面,Neon MCP Server通过Neon REST API进行接口交互,覆盖了从项目创建到数据迁移的全流程管理-2。下面是实际安装和配置的操作流程:

方式一:Smithery自动化安装(推荐快速体验) sh -c "$(curl -fsSL https://smithery.ai/install/neonmcp-server@neon)" 方式二:手动本地安装(开发调试) git clone https://github.com/neondatabase/neon-mcp-server.git cd neon-mcp-server npm install export NEON_API_KEY="your-api-key-here" npm start 方式三:Cloudflare Workers部署(生产环境) curl -fsSL https://github.com/neondatabase/neon-mcp-server/raw/main/deploy.sh | sh bunx wrangler secret put NEON_API_KEY

三种安装方式分别适用于不同场景:Smithery一键完成、最快上手;本地安装提供完全控制、便于调试;Cloudflare Workers稳定可靠、无需维护本地服务-2。

Neon官方还提供了Agent Skills功能,让AI编码助手获取Neon Python SDK和TypeScript SDK的上下文信息,从而提供更准确的代码建议-20。如果你使用Cursor、VS Code或Claude Code等编辑器,还可以通过OAuth一键认证配置Neon插件,自动安装Agent Skills并重启编辑器后,直接对AI助手说“Get started with Neon”即可开始使用-49。

四、底层原理:支撑AI助手Neon的技术栈

Neon能够实现“自然语言驱动数据库”的能力,底层依赖三大关键技术:

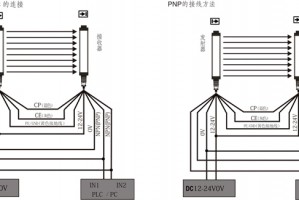

1. 模型上下文协议(MCP)

MCP采用客户端-主机-服务器架构,其中每个主机可以运行多个客户端实例,在客户端和服务器之间建立有状态的会话-。MCP协议包含数据层和通信层:数据层定义了基于JSON-RPC的协议规范,涵盖生命周期管理和核心原语(如工具tools、资源resources、提示prompts和通知notifications)-。这一协议让AI模型能够以标准化方式连接外部数据和服务,打破了过去模型各自为政的碎片化局面。

2. LLM无关引擎

以Opera Neon为例,其底层运行的是Opera自主研发的AI引擎,能够根据任务类型智能选择最合适的模型(如OpenAI、Google等),而不是绑定单一模型-11。这种“引擎+模型路由”的设计,让AI助手可以在不同场景下调用最匹配的能力。

3. 计算与存储分离

Neon的Postgres引擎采用Serverless架构,将计算和存储分离,可以即时创建、自动伸缩,并在不使用时缩容到零-。这种架构完美适配AI助手产生的突发性、按需工作负载。Opera Neon还采用了双执行环境设计:浏览器内的任务(Do)在用户本地会话中执行,而复杂的生成任务(Make)则创建云端虚拟机来处理-11。

从更宏观的视角看,2026年的AI助手正从“功能全面性”竞争加速向“用户心智占领”阶段进阶-。模型推理能力的持续提升,正在推动AI工具从降本工具转向真正的增收引擎-。而Neon系列产品以MCP协议为桥梁、以私有化部署为护城河,在这一轮AI Agent商业化浪潮中占据了一个独特而重要的生态位。

五、高频面试题与参考答案

以下整理了三道2026年AI Agent方向的高频面试题,供备考参考:

面试题1:什么是AI Agent?它与传统大模型(LLM)有什么区别?

参考答案:

AI Agent(AI智能体)是一种能够自主感知环境、理解用户意图、进行逻辑推理与任务规划、调用工具完成目标,并具备自我迭代能力的AI系统。其核心组件通常包括:感知模块(接收输入)、规划模块(任务分解)、工具调用模块(连接外部API/数据库)、记忆模块(短期/长期上下文)和执行模块(输出行动)。

与传统LLM的核心区别在于:传统LLM是“被动响应型”——你输入指令,它输出结果,不具备自主行动能力;而AI Agent具备“自主执行能力”——它可以理解高层目标、自主分解为子任务、调用相应工具并反馈执行结果。通俗地说,LLM像是一个“顾问”,Agent像是一个“执行助理”。

面试题2:什么是MCP(Model Context Protocol)?它的架构是怎样的?

参考答案:

MCP是由Anthropic提出的开放协议,旨在标准化大语言模型与外部数据源、工具之间的交互方式。它解决了过去每个模型都需要单独适配外部系统的碎片化问题。

MCP采用客户端-主机-服务器架构,核心分为两层:

数据层:基于JSON-RPC定义协议规范,管理客户端与服务器的通信生命周期

核心原语层:提供tools(工具)、resources(资源)、prompts(提示)和notifications(通知)四种基本能力

在这种架构下,一个MCP主机(如Claude Desktop)可以同时连接多个MCP服务器,分别对应数据库、文件系统、API服务等不同数据源,AI模型通过统一接口与它们交互。

面试题3:Neon MCP Server的核心能力是什么?适合哪些场景?

参考答案:

Neon MCP Server是一个基于MCP协议的开源工具,核心能力是让AI助手通过自然语言与Neon Postgres数据库进行交互,覆盖项目管理、分支管理、SQL执行和数据迁移等全流程操作。

适用场景包括:

开发调试:快速创建测试数据库和表结构,减少SQL记忆负担

团队协作:通过自然语言命令统一操作规范,降低沟通成本

自动化运维:将Neon MCP集成到CI/CD流程中,实现数据库操作的自动化

AI应用开发:作为AI Agent的“数据库感知层”,让Agent具备真正的数据操作能力

六、总结

本文围绕AI助手Neon这一核心主题,系统梳理了以下要点:

概念定位:Neon在AI助手领域对应多个方向——Opera Neon是AI浏览器,Neon AI是企业级AI定制平台,Neon MCP Server是AI-数据库连接协议。三者定位清晰,各司其职。

痛点解决:传统数据库操作存在SQL记忆负担重、工具切换频繁、错误风险高等痛点,Neon MCP Server通过自然语言交互从根本上降低了认知负担。

技术原理:MCP协议的客户端-主机-服务器架构是底层支撑,配合LLM无关引擎和计算存储分离架构,实现了AI助手与数据库的高效协同。

实战上手:通过Smithery自动化安装或手动克隆仓库,几分钟内即可完成Neon MCP Server的配置,让AI助手成为你的数据库管家。

重点强调:AI Agent正在成为2026年技术发展的主旋律,而MCP协议则是让AI真正“连接世界”的关键基础设施。理解了Neon背后的MCP机制,你就掌握了AI Agent从“对话”到“行动”的核心逻辑。下一篇文章我们将深入探讨MCP协议的底层实现原理,并带你在真实项目中手写一个自定义MCP Server,敬请期待!

参考文献:本文引用了Neon官方文档、MCP协议架构文档及行业分析报告等资料,数据截至2026年4月10日。